(Essayez l'IA de Yiaho, c'est gratuit !)

L’intelligence artificielle est devenue indispensable pour rédiger un email, coder un script ou simplement brainstormer des idées. Et rien n’est plus frustrant que d’attendre une éternité pour une réponse de ChatGPT.

Vous tapez votre requête, et au lieu d’une réponse fluide en quelques secondes, vous fixez les petits points qui dansent, ou un rond qui tourne… indéfiniment !

Si cela vous arrive de plus en plus souvent, vous n’êtes pas seul. En 2025, les plaintes sur les ralentissements de ChatGPT-5 explosent sur les forums et les réseaux sociaux.

Mais pourquoi ce phénomène s’aggrave-t-il ? Et surtout, comment y remédier ? Dans cet article rédigé par l’équipe technique de Yiaho, nous décortiquons les causes de ces lenteurs croissantes et vous présentons notre alternative ingénieuse : Yiaho, la plateforme IA qui réinvente l’accès aux modèles OpenAI !

Les raisons derrière les ralentissements croissants de ChatGPT

ChatGPT, développé par OpenAI, est un outil phénoménal, mais il n’est pas infaillible.

Avec des millions d’utilisateurs quotidiens, la plateforme fait face à des défis techniques et stratégiques qui expliquent pourquoi vos interactions deviennent de plus en plus laborieuses. Voici les principaux coupables, basés sur les retours d’utilisateurs et les analyses récentes.

1. Une demande explosive qui surcharge les serveurs

Depuis son lancement, ChatGPT a connu une adoption massive. En 2025, les pics d’utilisation, surtout en fin de journée ou lors d’événements majeurs comme des lancements de nouvelles fonctionnalités, entraînent une surcharge des serveurs. Résultat : des temps de réponse qui passent de 5-10 secondes à plus de 30 secondes, voire des interruptions totales.

Imaginez des millions de requêtes simultanées pour des tâches complexes, et les infrastructures cloud (hébergées en grande partie par Microsoft) peinent à suivre le rythme. Ce n’est pas un bug isolé, mais un symptôme d’une croissance incontrôlée.

2. Des ajouts de fonctionnalités au détriment des performances

OpenAI innove sans relâche : nouvelles versions de modèles (comme GPT-5.2 très bientôt), intégrations multimodales, ou outils de personnalisation. Mais ces évolutions ont un coût. Au lieu de prioriser l’optimisation des performances, l’équipe se concentre sur l’ajout de « belles » features, ce qui alourdit le système.

Par exemple, l’interface web garde en mémoire l’intégralité de vos conversations longues, forçant le navigateur à recalculer constamment le layout et à traiter des blocs de texte massifs avec des expressions régulières lentes.

Sur mobile ou en mode gratuit, cela se traduit par des gels, des réponses partielles ou des « timeouts » frustrants, même pour les abonnés payants.

3. La priorisation stratégique d’OpenAI : Les API avant tout

Voici le point clé qui rend les choses encore plus inégales : OpenAI privilégie explicitement ses clients API payants par rapport aux utilisateurs gratuits ou même aux abonnés ChatGPT Plus. Pourquoi ? Parce que les API alimentent des entreprises, des applications tierces et des services professionnels qui génèrent des revenus stables. En cas de surcharge, ce sont les utilisateurs « casual » sur la plateforme web qui trinquent en premier.

Les développeurs et les outils intégrés via API bénéficient d’une bande passante dédiée et de priorités de traitement supérieures. Résultat : sur ChatGPT, les réponses gratuites ou basiques rament de plus en plus, tandis que les flux API restent fluides. C’est une stratégie business claire, mais elle laisse les particuliers sur le carreau.

En résumé, ces facteurs combinés, demande massive, optimisations négligées et priorisation des pros, expliquent pourquoi ChatGPT semble « ramer » de plus en plus en 2025. Des astuces comme vider le cache du navigateur ou switcher vers GPT-4 aident un peu, mais ce ne sont que des pansements sur une jambe de bois.

Lire également à ce sujet : Pourquoi notre plateforme d’intelligence artificielle Yiaho est gratuite ? Notre philosophie

Yiaho : L’alternative intelligente pour des réponses ultra-rapides

Et si on arrêtait de subir ces lenteurs ?

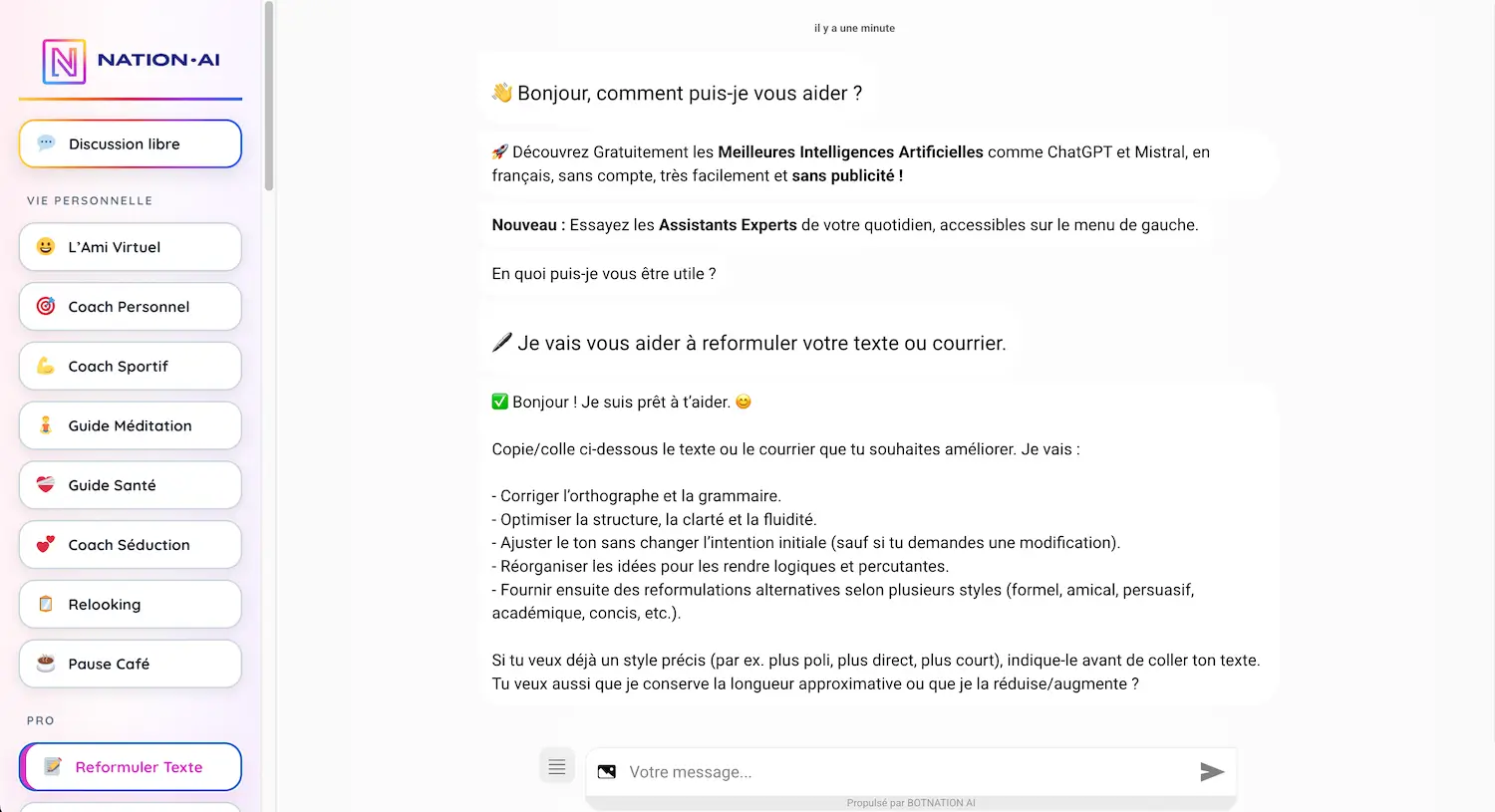

C’est là qu’intervient Yiaho, notre plateforme IA dédiée qui démocratise l’accès aux meilleurs modèles d’OpenAI via leur API officielle.

Contrairement à ChatGPT, Yiaho contourne les goulots d’étranglement de la plateforme grand public en s’appuyant directement sur les flux API priorisés.

Pourquoi Yiaho est plus judicieux ?

- Accès aux meilleurs modèles sans compromis : Profitez de GPT-4o, GPT-5.1 et des futures itérations en temps réel, sans les files d’attente des utilisateurs gratuits. Les API d’OpenAI sont optimisées pour la vitesse, avec des latences inférieures à 2 secondes même en pic d’activité.

- Fiabilité et scalabilité : Pas de surcharge UI ou de recalculs inutiles. Yiaho gère les conversations longues de manière efficace, en se focalisant sur l’essentiel : des réponses précises et instantanées.

- Équité pour tous : Que vous soyez un particulier, un freelance ou une équipe, Yiaho offre toutes ces IA gratuitement. C’est l’API OpenAI au service de l’utilisateur final, sans les frustrations de la plateforme native.

En optant pour Yiaho, vous alignez votre usage sur la stratégie d’OpenAI elle-même : prioriser la performance via API. C’est non seulement plus rapide, mais aussi plus économique à long terme. Adieu les heures perdues à attendre !

Les ralentissements de ChatGPT ne sont pas un bug, mais une feature d’un système sous tension.

Avec une demande en explosion et une priorisation claire vers les API, il est temps de repenser votre workflow IA. Yiaho n’est pas qu’une alternative : c’est la solution logique pour qui veut des réponses fluides et fiables, en surfant sur les forces mêmes d’OpenAI.