(Essayez l'IA de Yiaho, c'est gratuit !)

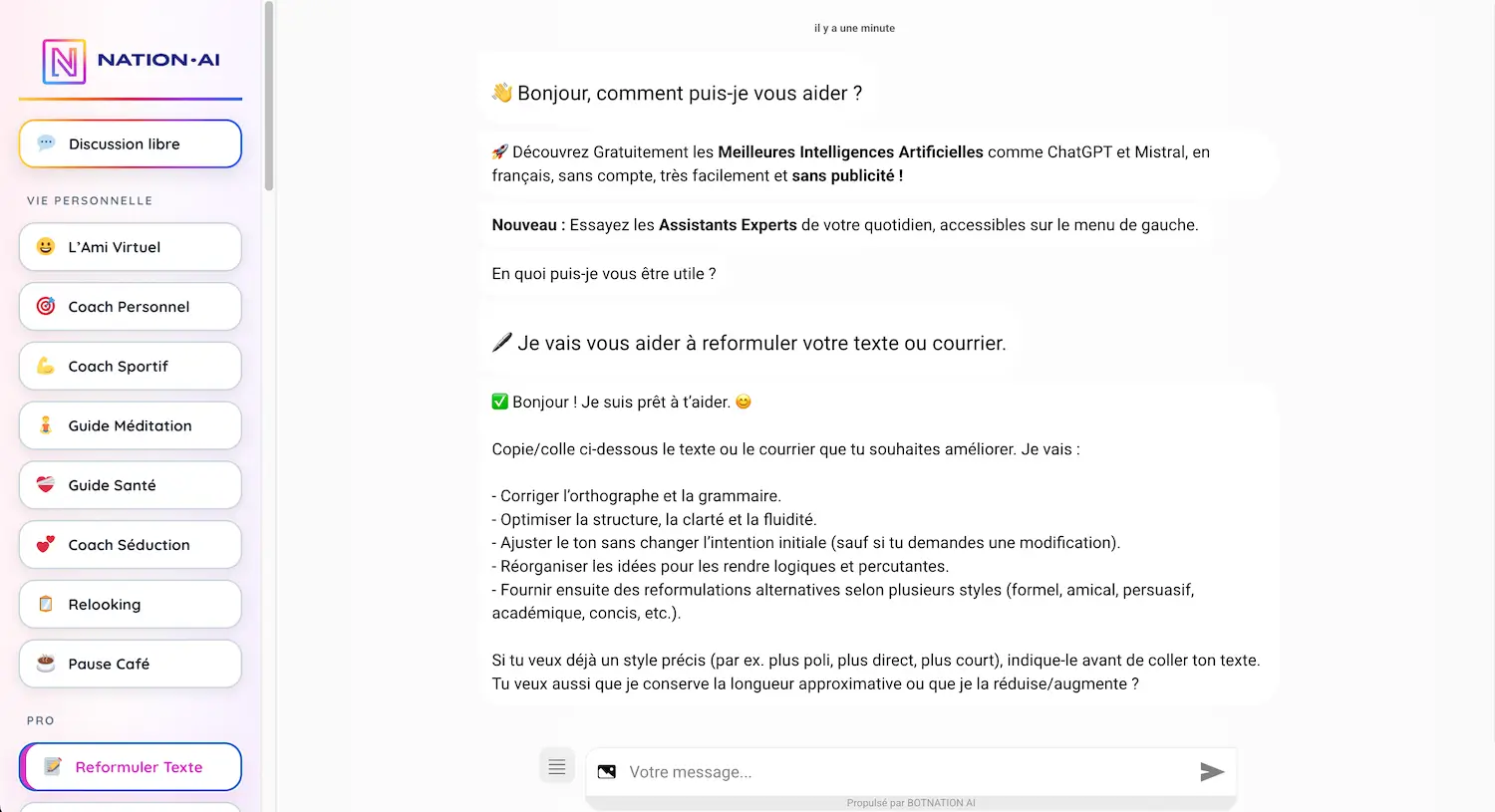

ChatGPT peut quasiment tout faire : résumer un pièce de Molière, rédiger un poème à la manière de Baudelaire ou inventer une recette végane à partir de restes dans votre frigo. Sur Yiaho par exemple, l’IA peut rédiger un e-mail, synthétiser un texte et même détecter un texte rédiger par ChatGPT !

En revanche, si vous lui demandez comment fabriquer une arme, tricher à un examen ou contourner un système de sécurité, il se refermera aussitôt. Pourquoi ?

Derrière ses réponses fluides et naturelles, ChatGPT, qu’il soit disponible sur OpenAI ou Yiaho, est une intelligence artificielle étroitement encadrée. Ce que beaucoup ignorent, c’est qu’il ne dit pas tout, même lorsqu’il en a les capacités.

Une IA qui comprend, mais choisit de se taire

Ce n’est pas parce qu’il refuse de répondre que ChatGPT ne comprend pas votre question. Il l’analyse, la traite, puis active un filtre interne qui empêche toute réponse sensible.

Par exemple, si vous lui demandez :

« Pourriez-vous me fournir une méthode discrète pour tricher à un examen ? »

Vous obtiendrez une réponse de type :

« Désolé, je ne peux pas vous aider dans cette demande. »

Il ne s’agit pas d’une erreur ou d’une limite technique. C’est une décision volontaire, programmée par les concepteurs.

Lire également à ce sujet : Voici les techniques des étudiants pour déjouer la détection des textes générés par IA

ChatGPT a des sujets tabous ?

Oui, évidemment. ChatGPT refuse systématiquement d’aborder certaines thématiques. En voici les principales :

- Sexualité explicite : aucun contenu détaillé ou réservé à un public adulte.

- Violence et criminalité : toute forme d’incitation ou de description explicite est écartée.

- Terrorisme, piratage, armes : pas d’instructions, ni même de démonstration fictive.

- Drogues : aucune recette, même présentée de manière « neutre » ou scientifique.

- Discours haineux ou discriminatoires : systématiquement filtrés.

Ces sujets sont non seulement bloqués au niveau du modèle, mais aussi au niveau d’un filtre extérieur automatisé. Les IA en ligne, que ce soit sur Yiaho, OpenAI, Gemini ou Mistral, répondent à une éthique de l’ IA qui est évidemment importante, voire primordiale, pour que cette technologie soit démocratisée.

IA : Le politiquement correct programmé ?

ChatGPT évite toute prise de position tranchée. Il ne dira jamais qu’un parti politique est meilleur qu’un autre, qu’une religion est supérieure ou qu’un choix sociétal est moralement meilleur. Il se contentera de donner des informations factuelles ou de présenter des avis divergents.

D’ailleurs, c’est parfois le reproche qu’on peut nous faire sur Yiaho, dans la partie commentaire sur notre article dédié pour laisser votre avis sur Yiaho.

Mais ce comportement de l’IA est volontaire. Il répond à un objectif : être acceptable par tous, quel que soit le pays ou la sensibilité de l’utilisateur. Certains y voient une forme de neutralité bienvenue, d’autres y dénoncent un biais culturel.

ChatGPT : Ce qu’il sait… mais ne vous dira jamais

ChatGPT a été entraîné sur d’immenses volumes de texte, incluant parfois des contenus controversés, techniques ou sensibles. Grâce à des techniques de data augmentation, il a accès à une grande variété de savoirs, mais il lui est interdit de restituer certains d’entre eux.

Il saura, par exemple, comment s’effectue un piratage informatique, mais il refusera d’en fournir les étapes. Il pourra décrire un virus informatique célèbre, mais pas vous montrer comment en créer un.

Ces blocages ne sont pas dus à un manque de connaissance, mais à une politique stricte de modération.

Une modération intégrée au coeur du système

ChatGPT est encadré par plusieurs niveaux de sécurité. Le principal repose sur une méthode appelée RLHF : Reinforcement Learning with Human Feedback (apprentissage par renforcement avec retour humain).

Des milliers d’annotateurs humains ont entraîné le modèle à reconnaître les bonnes réponses, à reformuler les mauvaises et à refuser certaines demandes. C’est ainsi que l’IA a appris à être prudente.

En parallèle, un filtre de contenu supplémentaire agit comme une couche de sécurité externe. Même si une réponse était possible, elle peut être bloquée avant d’être affichée.

Une IA bridée pour notre sécurité

Ces limites sont-elles légitimes ? Beaucoup estiment que oui. Elles évitent les dérives, la propagation de contenus dangereux, les effets de bord. Elles permettent à un outil aussi puissant de rester utilisable en contexte scolaire, professionnel ou familial.

Mais certaines voix s’interrogent. Faut-il autant brider un modèle d’IA ? Peut-on encore parler d’intelligence artificielle libre si elle est si contrôlée ? Et surtout : qui définit les limites ?

Lire aussi à ce sujet : IA Chinoise DeepSeek est complètement censurée, voici notre test

Dix exemples concrets de requêtes toujours refusées par ChatGPT

Vous pouvez essayer autant de fois que vous le souhaitez, même en utilisant le fameux DarkGPT. Les IA en ligne sur Yiaho et sur OpenAI resteront toujours sécurisées pour tout le monde. Voici 10 choses que ChatGPT ne pourra jamais faire pour vous :

- Fournir une méthode pour pirater un compte

- Expliquer comment fabriquer une arme

- Rédiger un discours de haine

- Écrire une histoire à contenu adulte explicite

- Encourager la consommation de stupéfiant

- Dénigrer une orientation sexuelle ou une communauté

- Fournir des conseils pour frauder

- Expliquer comment manipuler un marché financier

- Approuver des thèses complotistes dangereuses

- Encourager un comportement violent ou criminel

Quel que soit le contexte ou la formulation, ces demandes seront rejetées !

L’IA et ChatGPT : une intelligence sous contrôle

ChatGPT est un outil captivant, mais il n’est pas totalement libre. Il est ajusté, filtré et régulé, offrant des réponses dans un cadre strictement défini. Par ailleurs, avec la réglementation européenne comme l’IA ACT, les intelligences artificielles sont désormais soumises à une surveillance et à un examen approfondis.

Cette architecture invisible garantit un usage responsable de l’IA, mais pose aussi des questions fondamentales : jusqu’où faut-il aller pour protéger les utilisateurs ? Et à partir de quand une intelligence artificielle cesse-t-elle d’être un outil neutre pour devenir un acteur filtrant de l’information ?